En fotografía digital, el formato del sensor de imagen es la forma y el tamaño del sensor de imagen.

El formato del sensor de imagen de cámaras digitales determina el ángulo de visión de un objetivo específico cuando está utilizado con una cámara determinada. Particularmente, los sensores de imagen en cámaras réflex digitales tienden a ser más pequeños que el área de 24x36 mm de las cámaras de 35 mm, y por lo tanto llevan a un ángulo de visión más estrecho. Para un número dado de píxeles en un sensor, cuanto más grande sea el sensor de imagen producirá imágenes de más alta calidad porque los píxeles individuales tendrán un tamaño mayor.

Los objetivos producidos para las cámaras de película de 35 mm se pueden montar bien en los cuerpos de las cámaras digitales, pero el círculo de imagen del objetivo del sistema de 35 mm es más grande que lo requerido por el sensor, e introduce luz indeseada en el cuerpo de la cámara. Por otro lado, el menor tamaño del sensor de imagen -comparado a los del formato de 35 mm-, resulta en el recorte de la imagen. Este último efecto es conocido como el recorte del campo visual; el cociente del tamaño del formato es conocido como el factor de recorte o factor de multiplicación de la distancia focal.

Tamaño del sensor

En igualdad de circunstancias, los sensores más grandes capturan imágenes con menos ruido y mayor rango dinámico que los sensores más pequeños. Las características deseables tanto de la relación señal/ruido y de la ganancia unitaria del sensor se escalan con la raíz cuadrada del área del sensor.

Desde diciembre de 2007, muchas DSLRs tienen áreas de sensor alrededor de los 370 mm2, mientras que muchos sensores de cámaras compactas tienen una décimo quinta parte del área de esa superficie: un sensor estándar de 1/2.5" tiene una superficie de 24.7 mm2 Así, un sensor DSLR típico tendrá una relación señal/ruido casi 4 veces mayor que las típicas cámaras digitales compactas:

Debido a sus sensores más grandes, las DSLRs generalmente puede tomar fotogramas de alta calidad en ISO 1600, 3200, o aún velocidades más altas, mientras que las cámaras compactas tienden a producir imágenes granulosas incluso en ISO 400. Este problema es exacerbado por el número de píxeles; la duplicación del número de píxeles en un sensor de un tamaño determinado, significa que cada píxel tiene la mitad del tamaño original, y por lo tanto es más ruidoso y menos sensible.

Función del procesador de imagen

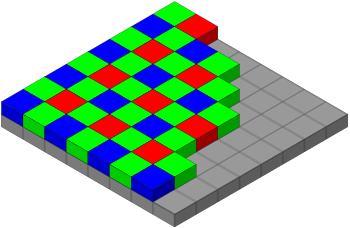

En fotografía digital, los fotodiodos del sensor no reciben la información de color,

sino que se recibe en escala de grises (a diferencia de las películas de 35mm). Por ello

es necesario aplicar un filtro de colores primarios (filtro de Bayer) siguiendo un patrón

en mosaico. Según Bayer, la información obtenida de los fotosensores verde

es la luminancia, mientras que los fotosensores azul y rojo conforman la crominancia.

Aquí entra la función principal del procesador de imagen, y es la de unificar la información

de luminancia y crominancia de cada píxel (formato RAW) y utilizarla para interpolar la

información de color y brillo (comprimida en JPEG o en formato TIFF).

CCD y CMOS

A diferencia del rollo fotográfico, una cámara digital posee en su interior un sensor que convierte la luz en cargas eléctricas.

El sensor de imágenes utilizado por la mayoría de las cámaras digitales es el CCD (en español conocido como dispositivo de carga acoplada) aunque están también aquellas que utilizan la tecnología del CMOS. Una forma de explicar el funcionamiento de estas, es imaginando un panel lleno de pequeñas celdas, en donde una vez que el sensor convierte la luz en electrones, estos son leídos al momento de estrellarse contra el panel. La diferencia entre estos dos tipos de sensores son que:

El CCD transporta la carga a través del chip y lee la información en una esquina del panel. Luego un convertidor análogo a digital, mide la cantidad de carga en cada celda y cambia cada pixel en un valor binario.

El CMOS usa varios transistores que están ubicados en cada celda, para luego mover la carga a través de un cableado interno.

Estas diferencias de sensores nos llevan a algunas ventajas y desventajas que mencionaremos a continuación:

-Los sensores CCD logran imágenes de alta calidad y con poco ruido, en cambio los CMOS son más susceptibles al ruido.

- Debido a que en cada pixel (celda) de un sensor CMOS, puede haber muchos transistores, la sensibilidad luminosa de este chip es menor, debido a que muchos fotones en vez de golpear al foto-diodo golpean en algún transistor.

- Los CMOS por lo general consumen menos energía que los CCD, debido a que estos últimos deben realizar un proceso que utiliza mayor energía, que puede llegar a ser hasta 100 veces mayor que al otro.

- CCDs son producidos en masa hace ya un buen tiempo, por lo cual tecnológicamente están más maduros, y tienden a ofrecer una mejor calidad y cantidad de pixeles.

No hay comentarios:

Publicar un comentario

Deje su mensaje , gracias